La importancia de la inteligencia artificial confiable para unas relaciones gubernamentales estratégicas

La inteligencia artificial está cada vez más presente en las estrategias de relaciones gubernamentales, pero no toda IA sirve para procesos que exigen precisión, consistencia y bajo riesgo de error. En entornos político-regulatorios, donde las decisiones impactan en el cumplimiento, el riesgo y la reputación, el uso de la IA debe ir más allá de las herramientas genéricas y centrarse en sistemas confiables, bien estructurados y alineados con el contexto de la organización.

Si trabajas en relaciones gubernamentales, compliance o advocacy, sigue este texto para entender cómo la inteligencia artificial confiable puede convertirse en un diferencial estratégico en tu día a día.

1. ¿Qué es la confiabilidad en la IA?

En las relaciones gubernamentales, la confiabilidad significa que el sistema de IA opera correctamente y de forma consistente dentro de un contexto específico, con pocas fallas.

Cuanto más tiempo logra funcionar de manera estable un sistema, más confiable es.

El nivel de confiabilidad aceptable puede variar mucho dependiendo de la aplicación. Para tener una idea, en contextos recreativos, como la generación de imágenes artísticas por IA, un nivel de acierto del 33% puede ser suficiente, ya que de cada tres imágenes creadas, una puede aprovecharse. Pero en sectores críticos, como la aviación civil, incluso el 99% de confiabilidad se considera inaceptable, dado el impacto de un fallo.

Por otro lado, en los procesos regulatorios y políticos, el error puede impactar las decisiones estratégicas y el riesgo de la empresa.

Por eso, la IA utilizada en este entorno debe ofrecer una alta confianza y control, y no solo recursos de “caja mágica”.

2. La IA no es una “caja mágica”: la confiabilidad depende del contexto

La inteligencia artificial funciona sobre la base de probabilidades y estadística, no de reglas fijas. Esto la hace flexible, pero también sensible al contexto: pequeños cambios en los datos o en los entornos pueden generar respuestas inconsistentes.

Esta complejidad explica por qué las interacciones con herramientas como ChatGPT pueden, a veces, parecer inconsistentes. Pero los usuarios avanzados saben que es necesario guiar a la IA con diversas preguntas, refinando el contexto y los criterios hasta llegar a una respuesta útil. Esto sucede porque existe un constante trade-off entre flexibilidad y precisión.

Así, cuando se usan sin una orientación clara, las herramientas abiertas como los asistentes genéricos pueden generar ruido en lugar de insights accionables.

Lee también nuestro artículo "Si la hoja de cálculo muere, nosotros morimos con ella” y descubre cómo la dependencia de las hojas de cálculo y los procesos manuales amenaza la continuidad y el compliance en la Industria 4.0.

3. ¿Por qué una alta confiabilidad marca la diferencia?

En relaciones gubernamentales, la confiabilidad es crítica porque las decisiones se basan en datos legislativos, políticos y regulatorios de alto impacto. Un sistema de IA poco confiable puede distorsionar información, generar alertas erróneas o ignorar iniciativas estratégicas.

Confiar en análisis mal calibrados o en resúmenes imprecisos puede comprometer oportunidades de advocacy, compliance e incluso la reputación de la empresa. La alta confiabilidad reduce la incertidumbre y aumenta la asertividad de las estrategias.

4. Estructurar la IA para microactividades

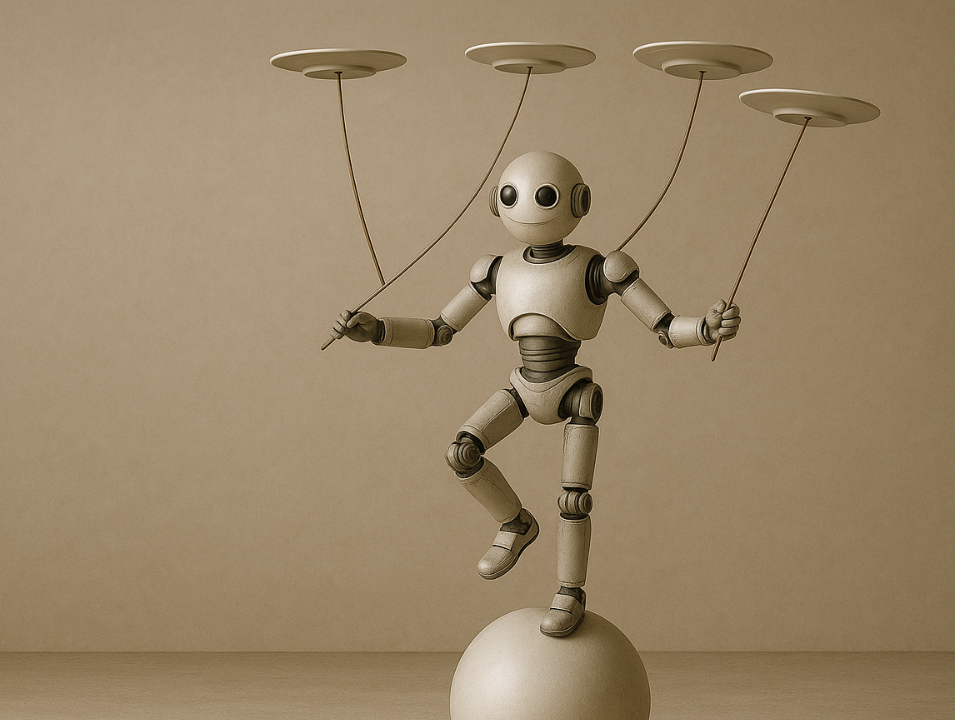

Solo usar la IA en interfaces genéricas no es suficiente. Al igual que los robots de soldadura en una fábrica funcionan bien cuando operan dentro de un flujo de trabajo bien definido, la IA en relaciones gubernamentales debe estructurarse para microactividades específicas. Esto incluye tareas como:

- Identificar temas estratégicos.

- Filtrar proposiciones legislativas relevantes.

- Generar resúmenes estandarizados.

- Enviar alertas precisas.

Con cada microactividad, el contexto se afina, aumentando la confiabilidad del conjunto de acciones.

Aquí vale la pena conocer el Agente de Informes de Sigalei. Transforma datos complejos en análisis y gráficos listos para ser enviados, con alta precisión y automatización.

5. Cómo usar IA confiable en la práctica

Para implementar una IA confiable en las relaciones gubernamentales, es necesario: definir el alcance de las actividades clave, mapear el contexto regulatorio y político de la empresa, establecer parámetros claros de relevancia y riesgo, y mantener un flujo de validación humana constante.

La IA debe ser un acelerador de análisis, no un sustituto del juicio estratégico. Cuando está bien estructurada, la IA confiable amplifica la capacidad de monitorear el entorno político-regulatorio, anticipar cambios y proteger o expandir el espacio de actuación de la organización.

6. Hiperespecialización como modelo de confianza

Sigalei, por ejemplo, aplica el concepto de hiperespecialización: los agentes de IA están diseñados para realizar tareas muy específicas en el flujo de las relaciones gubernamentales y político-regulatorias.

En lugar de un solo robot para “todo”, varios agentes especialistas actúan en etapas distintas, calibrados según el contexto de la organización. Esto permite que cada etapa opere con mayor precisión, evitando el ruido y aumentando la calidad de los insights que respaldan la toma de decisiones estratégicas.

En Sigalei entendemos que la confiabilidad en inteligencia artificial solo es posible con hiperespecialización. Por lo tanto, estructuramos nuestros agentes de IA para realizar microactividades específicas en los flujos de relaciones gubernamentales.

Cada tarea, desde la identificación de temas estratégicos hasta la generación de resúmenes y alertas, está diseñada con precisión y calibrada con el contexto adecuado. Este cuidado garantiza no solo mayor confiabilidad, sino también más agilidad e inteligencia en el proceso de toma de decisiones.

¿Quieres aplicar la IA de forma segura en tu proceso de relaciones gubernamentales?

¡Habla con nuestro equipo! Conversemos sobre cómo transformar tu operación con soluciones de IA personalizadas, confiables y precisas.