A importância da inteligência artificial confiável para relações governamentais estratégicas

A inteligência artificial está cada vez mais presente nas estratégias de relações governamentais, mas nem toda IA serve para processos que exigem precisão, consistência e baixo risco de erro. Em ambientes político‑regulatórios, em que decisões impactam conformidade, risco e reputação, o uso de IA precisa ir além de ferramentas genéricas e centrar‑se em sistemas confiáveis, bem estruturados e alinhados ao contexto da organização.

Se você atua com relações governamentais, compliance ou advocacy, acompanhe este texto para entender como a inteligência artificial confiável pode se tornar um diferencial estratégico no seu dia a dia.

1. O que é confiabilidade em IA?

Em relações governamentais, confiabilidade significa que o sistema de IA opera corretamente e de forma consistente dentro de um contexto específico, com poucas falhas.

Quanto mais tempo um sistema consegue funcionar de forma estável, mais confiável ele é.

O nível de confiabilidade aceitável pode variar muito, dependendo da aplicação. Para se ter uma ideia, em contextos recreativos, como na geração de imagens artísticas por IA, um nível de acerto de 33% pode ser suficiente, pois a cada três imagens criadas, uma pode ser aproveitada. Mas em setores críticos, como a aviação civil, até mesmo 99% de confiabilidade é considerado inaceitável, dado o impacto de uma falha.

Já em processos regulatórios e políticos, o erro pode impactar decisões estratégicas e o risco da empresa.

Por isso, a IA utilizada nesse ambiente precisa oferecer alta confiança e controle, não apenas recursos de “caixa mágica”.

2. IA não é uma “caixa mágica”: confiabilidade depende de contexto

A inteligência artificial funciona com base em probabilidades e estatística, e não em regras fixas. Isso a torna flexível, mas também sensível ao contexto: pequenas mudanças em dados ou ambientes podem gerar respostas inconsistentes.

Essa complexidade explica por que interações com ferramentas como o ChatGPT podem, por vezes, parecer inconsistentes. Mas usuários avançados sabem que é preciso orientar a IA com diversas perguntas, refinando o contexto e os critérios até chegar a uma resposta útil. Isso acontece porque há um trade-off constante entre flexibilidade e precisão.

Assim, quando usadas sem orientação clara, ferramentas abertas como assistentes genéricos podem gerar ruído em vez de insights acionáveis.

Leia também nosso artigo "Se a planilha morre, a gente morre junto” e descubra como a dependência de planilhas e processos manuais ameaça a continuidade e o compliance na Indústria 4.0.

3. Por que alta confiabilidade faz diferença?

Em relações governamentais, a confiabilidade é crítica porque decisões são baseadas em dados legislativos, políticos e regulatórios de alto impacto. Um sistema de IA pouco confiável pode distorcer informações, gerar alertas errados ou ignorar iniciativas estratégicas.

Confiar em análises mal calibradas ou em resumos imprecisos pode comprometer oportunidades de advocacy, compliance e mesmo a reputação da empresa. Alta confiabilidade reduz incertezas e aumenta a assertividade das estratégias.

4. Estruturar a IA para microatividades

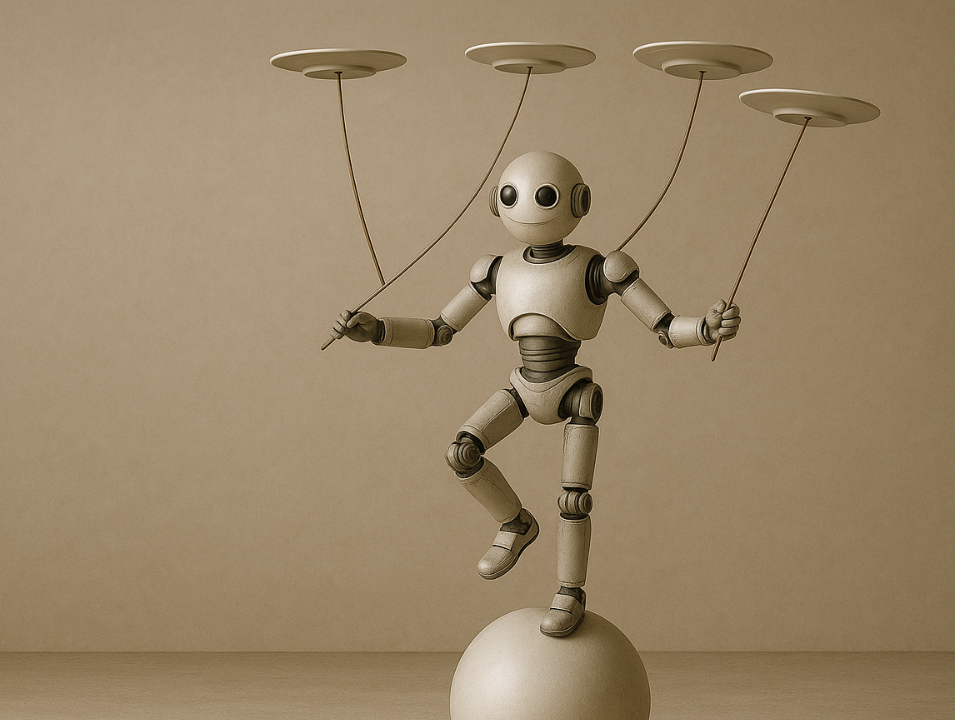

Apenas usar IA em interfaces genéricas não basta. Assim como robôs de solda em uma fábrica atuam bem quando operam dentro de um fluxo bem definido, a IA em relações governamentais precisa ser estruturada para microatividades específicas. Isso inclui tarefas como:

- Identificar temas estratégicos.

- Filtrar proposições legislativas relevantes.

- Gerar resumos padronizados.

- Enviar alertas precisos.

A cada microatividade, o contexto é afinado, aumentando a confiabilidade do conjunto de ações.

Aqui, vale conhecer o Agente de Relatórios da Sigalei. Ele transforma dados complexos em análises e gráficos prontos para envio, com alta precisão e automação.

5. Como usar IA confiável na prática

Para implementar IA confiável em relações governamentais, é preciso: definir o escopo das atividades-chave, mapear o contexto regulatório e político da empresa, estabelecer parâmetros claros para relevância e risco, e manter um fluxo de validação humana constante.

A IA deve ser um acelerador de análise, não uma substituta do julgamento estratégico. Quando bem estruturada, a IA confiável amplifica a capacidade de monitorar o ambiente político‑regulatório, antecipar mudanças e proteger ou expandir o espaço de atuação da organização.

6. Hiperespecialização como modelo de confiança

A Sigalei, por exemplo, aplica o conceito de hiperespecialização: agentes de IA são projetados para desempenhar tarefas muito específicas no fluxo de relações governamentais e político‑regulatórias.

Em vez de um único robô para “tudo”, vários agentes especialistas atuam em etapas distintas, calibrados com o contexto da organização. Isso permite que cada etapa opere com maior precisão, evitando ruído e aumentando a qualidade dos insights que apoiam a tomada de decisão estratégica.

Na Sigalei, entendemos que a confiabilidade em inteligência artificial só é possível com hiperespecialização. Por isso, estruturamos nossos agentes de IA para desempenhar microatividades específicas nos fluxos de relações governamentais.

Cada tarefa, da identificação de temas estratégicos à geração de resumos e alertas, é desenhada com precisão e calibrada com o contexto adequado. Esse cuidado garante não só maior confiabilidade, mas também mais agilidade e inteligência no processo de tomada de decisão.

Quer aplicar IA com segurança no seu processo de relações governamentais?

Fale com a nossa equipe! Vamos conversar sobre como transformar sua operação com soluções de IA personalizadas, confiáveis e precisas.